AIに見えているものを確認する

この章でできるようになること

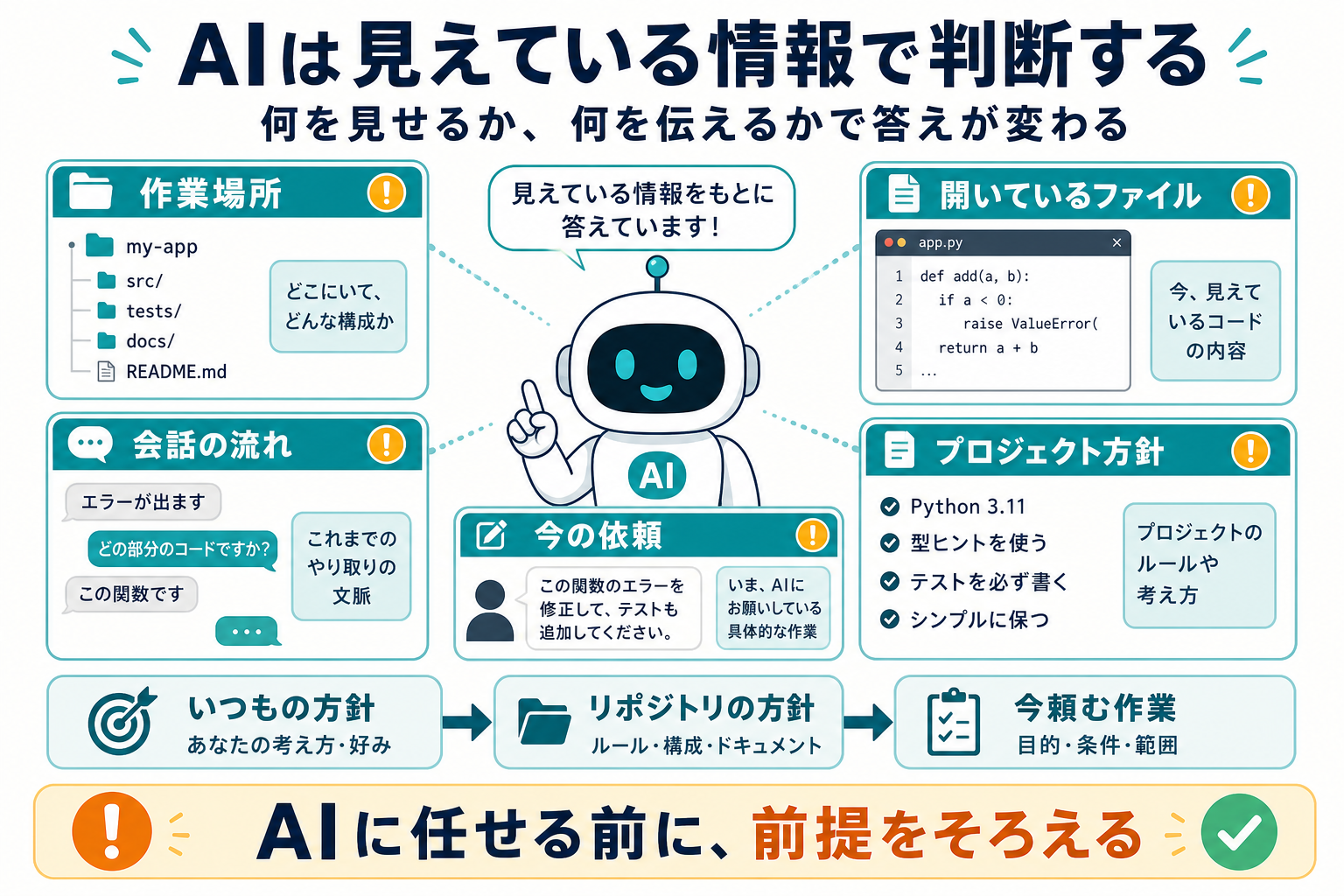

コーディングエージェントが、作業ディレクトリ、会話、指示ファイル、実行結果をどのように文脈として使うのかを説明できるようになります。

第0部で教材リポジトリの中でAIエージェントを起動した理由を、ここで回収します。

まず知っておくこと

AIエージェントは、常にPC全体を見ているわけではありません。 多くの場合、今の作業ディレクトリや、会話で与えられた情報を中心に作業します。

第1部で確認した pwd は、ここでも重要です。

AIエージェントをどのディレクトリで起動したかによって、見ているプロジェクトが変わります。

AIが回答の前提として使う情報を、コンテキストと呼ぶことがあります。 日本語では「文脈」と考えるとわかりやすいです。

作業ディレクトリ

作業ディレクトリは、今作業している場所です。

教材リポジトリでAIエージェントを使うなら、次のような場所にいる必要があります。

pwd

表示例:

/home/あなたのユーザー名/src/github.com/btajp/vibe-coding-starter

別のディレクトリで起動すると、AIは別の文脈で考える可能性があります。

第0部で教材リポジトリへ cd してからAIエージェントを起動したのは、そのためです。

迷ったら、AIに頼む前に自分で pwd を見ます。

そのうえで、AIにも「今いるディレクトリを確認してから答えてください」と頼むと安全です。

会話の文脈

AIは、会話で伝えた内容を文脈として使います。

たとえば、次のように伝えると、回答の前提が揃います。

私は第2部を進めています。

今はWebチャットとコーディングエージェントの違いを学んでいます。

まだファイルは変更しないでください。

逆に、前提を伝えないと、AIは一般論で答えるか、推測します。 推測が混ざると、文章としては自然でも、自分の状況には合わない答えになることがあります。

コンテキストウィンドウ

AIが一度に扱える文脈の量には上限があります。 この上限を、コンテキストウィンドウと呼ぶことがあります。

会話が長くなると、最初に話した細かい条件や判断理由が薄れたり、要約された形で扱われたりすることがあります。 そのため、大事な決定や要件は、会話の中だけに置かず、ファイルに残すほうが安全です。

たとえば、AIに質問してもらい、それに自分が答えたあとで、次のように頼みます。

今のやり取りを、あとで実装に使える要件メモとしてMarkdownに整理してください。

目的、決まったこと、未決定のこと、やらないこと、次に確認することを分けてください。

パスワード、APIキー、トークン、秘密鍵は含めないでください。

まだファイルは変更しないでください。

そのメモをファイルに保存しておけば、会話を短くしたあとでも、AIにそのファイルを読ませて作業を再開しやすくなります。 ただし、要件メモにも秘密情報は書きません。 一部のAIツールでは、長くなった会話を要約して続ける操作をcompactと呼ぶことがあります。 名前はツールによって違いますが、「長い会話はそのまま永遠に残るとは限らない」と考えておくと安全です。

セッションの再開

AIツールによっては、前の会話や作業をあとから再開できることがあります。 このような再開を、resumeと呼ぶことがあります。

resumeすると、前の会話を引き継げる場合があります。 ただし、何がどこまで引き継がれるか、AGENTS.mdのような指示ファイルをいつ読み直すかは、ツールやバージョンによって変わることがあります。

そのため、再開した直後は、AIに次のように確認させると安全です。

このセッションで、今の回答の前提として使えそうな情報を整理してください。

特に、作業ディレクトリ、読めている指示ファイル、直近の目的、

まだ編集してよいかどうかを分けて説明してください。

まだファイルは変更しないでください。

会話を再開できても、作業の正本は会話だけに置かないほうが安全です。 重要な要件、決定、未決定事項は、Markdownファイルやissue、READMEなどに残しておくと、AIにも人間にも読み直しやすくなります。

指示ファイル

このリポジトリには、AIエージェント向けの指示ファイルがあります。

AGENTS.mdCLAUDE.md

CLAUDE.md は AGENTS.md を参照する形になっています。

これらのファイルには、この教材で守るべき方針が書かれています。 たとえば、学習者向け本文は日本語で書くこと、AIに丸投げする教材にしないこと、危険なコマンドには注意を書くことなどです。

第0部でAIエージェントを教材リポジトリで起動したのは、こうした指示も含めて作業させるためでした。

ただし、指示ファイルがあるからといって、AIの出力が必ず正しいわけではありません。 指示ファイルは「方針を伝える材料」であり、最終確認は人間が行います。

実行結果とログ

AIにコマンド実行を頼むと、その結果をもとに次の判断をすることがあります。

たとえば、次のような確認です。

git status

npm run build

ただし、AIにコマンド実行を頼む前に、何をするコマンドなのかを確認します。 第1部で扱った危険なコマンド、権限、PATHの知識をここで使います。

読み取り中心の確認コマンドから始めると、状況を整理しやすくなります。

たとえば、pwd、ls、git status、npm run build のように、何を確認するためのコマンドか説明できるものから使います。

ただし、npm run build は確認目的で使うことが多い一方で、プロジェクトによっては build ディレクトリなどの生成物を作る場合があります。

完全に見るだけのコマンドとは限らないため、実行前に何が起きるかを確認します。

やってみる

AIエージェントに、見えている文脈を説明させます。

今このAIエージェントが、回答の前提として使えそうな情報を整理してください。

特に、作業ディレクトリ、会話で伝えたこと、AGENTS.mdのような指示ファイル、

実行結果として渡された情報を分けて説明してください。

まだファイルは変更しないでください。

次に、自分でも確認します。

pwd

ls

表示された場所が教材リポジトリかどうかを見ます。 必要なら、次も確認します。

git remote -v

教材リポジトリを見ているつもりで別のリポジトリにいると、AIへの依頼もずれていきます。

何が起きたのか

第0部でAIに「この教材の目的を要約して」と頼めたのは、教材リポジトリをcloneし、その中でAIエージェントを起動したからです。

AIがファイルを見られる状態だったので、一般論ではなく、この教材に沿った説明ができました。

一方で、AIに見えている情報が古かったり、一部だけだったりする場合もあります。 「見えているはず」と思い込まず、必要なファイルや確認結果を具体的に示します。

運用者の視点

AIに任せる前に、次を確認します。

- 今いるディレクトリは正しいか

- AIは対象リポジトリを見ているか

- 指示ファイルは読まれていそうか

- まだ編集してほしくない段階か

- 実行してよいコマンドか

これは面倒な儀式ではありません。 違うリポジトリで変更してしまう事故を防ぐための確認です。

AIに聞いてみよう

このリポジトリでAIエージェントに作業を頼む前に、

確認すべきことをチェックリストにしてください。

特に、作業ディレクトリ、対象ファイル、編集の有無、コマンド実行の有無、

秘密情報の扱いを含めてください。

まだファイルは変更しないでください。

次へ

次は、AIツールの選択肢を知ります。